Avanço da IA nas eleições acende alerta

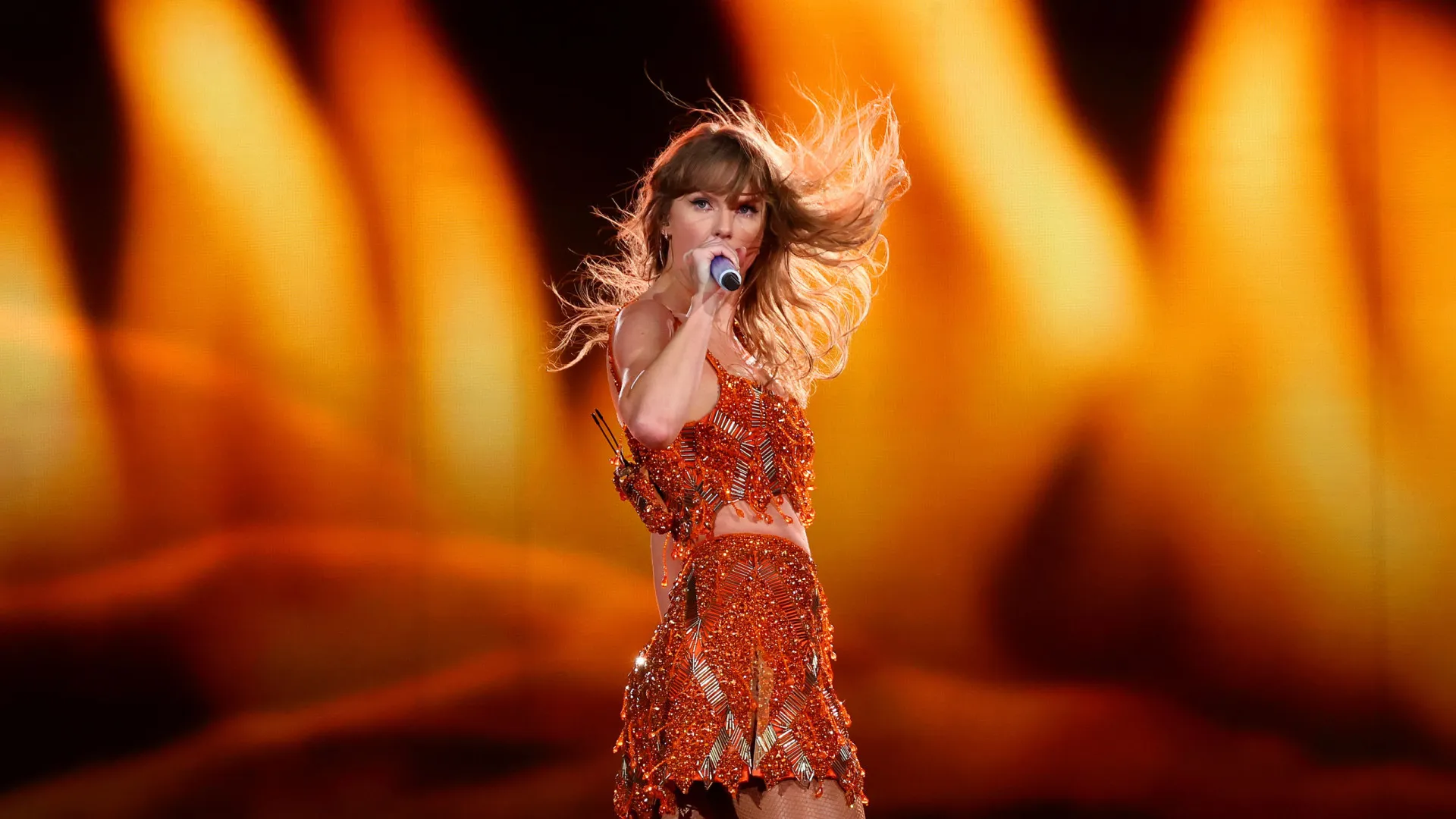

Avanço da IA nas eleições acende alerta - Crédito: Divulgação Nos últimos anos, a inteligência artificial saiu do campo técnico e passou a influenciar diretamente o debate público. Em períodos eleitorais, esse impacto fica ainda mais evidente. Ferramentas capazes de produzir textos, imagens e até vídeos realistas mudaram a velocidade e a escala com que informações circulam. Em 2026, o tema ganhou espaço não apenas entre especialistas, mas também entre autoridades eleitorais, jornalistas e eleitores comuns. O motivo é simples: a mesma tecnologia que pode melhorar a comunicação também pode ser usada para confundir, distorcer ou manipular narrativas. Entender onde estão os principais riscos ajuda o leitor a navegar com mais segurança em um ambiente informacional cada vez mais complexo. Onde a inteligência artificial já impacta as eleições A presença da IA nas campanhas não começou agora. Equipes políticas já usam análise de dados há anos para entender melhor o comportamento do eleitor. O que mudou recentemente foi a sofisticação das ferramentas disponíveis. Hoje, a inteligência artificial pode ajudar a identificar padrões de engajamento, mapear temas que mobilizam o público e ajustar mensagens para diferentes perfis. Na prática, isso torna a comunicação mais direcionada. O problema surge quando a tecnologia é usada sem transparência ou com intenção de enganar. Em um cenário de disputa eleitoral, pequenos conteúdos fora de contexto podem ganhar proporções grandes em pouco tempo. Como ferramentas detectoras de IA entram nesse cenário Com o aumento do volume de conteúdo automatizado, cresceu também a busca por formas de verificação. Nesse contexto, soluções como um detector de IA passaram a ser utilizadas como apoio técnico por jornalistas, pesquisadores e equipes de checagem. Essas ferramentas analisam padrões linguísticos e estruturais para indicar quando um texto pode ter sido gerado por sistemas automatizados. Elas não funcionam como prova definitiva isolada, mas ajudam a levantar sinais de alerta. Durante períodos eleitorais, esse tipo de recurso ganha importância porque o fluxo de informação cresce muito. Quanto mais rápido um conteúdo viraliza, maior a necessidade de triagem inicial para identificar materiais suspeitos. Ainda assim, especialistas costumam reforçar que nenhuma ferramenta substitui a verificação humana e a análise de contexto. Deepfakes ampliam o nível de preocupação Se alguns anos atrás o foco estava apenas em textos enganosos, hoje a atenção também se volta para vídeos e áudios manipulados. Os chamados deepfakes evoluíram bastante e já conseguem simular rostos e vozes com alto grau de realismo. Em disputas eleitorais, esse tipo de material pode gerar confusão rapidamente, principalmente quando circula em aplicativos de mensagem ou redes sociais fechadas. O desafio é que a produção desse conteúdo ficou mais acessível, enquanto a verificação ainda exige tempo e análise técnica. Muitas vezes, quando a checagem acontece, o material já se espalhou. Por isso, autoridades eleitorais e plataformas digitais vêm discutindo formas de identificar e sinalizar esse tipo de conteúdo com mais rapidez. O impacto no comportamento do eleitor A presença crescente de conteúdo sintético muda também a postura necessária do público. O eleitor que antes se preocupava apenas com a fonte da notícia agora precisa observar outros sinais. Entre eles: Qualidade incomum de imagens ou vídeos Falas que parecem artificiais Conteúdos muito alarmistas Informações sem fonte clara Pesquisas sobre comportamento digital indicam que muitas pessoas ainda têm dificuldade em distinguir materiais manipulados, especialmente quando são bem produzidos. Isso reforça a importância da educação midiática e do consumo mais cuidadoso de informação política. O desafio das regras e da fiscalização A regulação do uso de inteligência artificial em campanhas ainda está em construção em vários países. O tema envolve equilíbrio delicado entre liberdade de expressão, inovação tecnológica e proteção do processo democrático. Entre as discussões mais frequentes estão a rotulagem de conteúdo sintético, a responsabilidade sobre deepfakes maliciosos e a transparência no uso de automação em campanhas. No Brasil, o debate também avança gradualmente. A tendência é que as regras se tornem mais específicas conforme a tecnologia evolui e novos casos surgem.